Alkotni tanít egy mesterséges intelligenciát a Google

Képes-e zenét írni, vagy festményeket készíteni egy gép? Ha igen, hogyan? Ha nem, miért nem? Ezekre a kérdésekre keresi a választ a Google új projektje, a Magenta keretén belül. A csoport olyan algoritmust próbál írni, ami egyedi zenét, videót, vagy valamilyen vizuális alkotást tud készíteni, az emberektől függetlenül.

A Magenta csapat a Google nyílt forráskódú gépi tanulási motorját, a TensorFlowt használja ahhoz, hogy alkotásra képezzék ki az MI-t. Adam Roberts, a csapat tagja egy olyan digitális szintetizátor programot demózott a Moogfesten, ami

képes zenét alkotni, miután hallott ember által játszott hangjegyeket.

A zenébe bele tudja szőni saját ötleteit, ebből készít hallgatható dallamot, többféle stílusban.

A csapat június elsején indítja el a tesztelést, és rendszeresen tesznek közzé majd frissítéseket az új eredményekről. A projektet a Google Brain AI csapatán belül végzik, akik többek közt a Fordítóért, és a Fotókért is felelnek. A cél az, hogy a gépi intelligencia

egyedi és kreatív alkotásokat hozzon létre,

zene, művészet, vagy akár film terén is.

A projekt először a zenére koncentrál. A Magenta nyilvánossá teszi a GitHub kódmegosztón a használt eszközöket és programokat, hogy a közösség is segíthessen az adatgyűjtésben. Először egy egyszerű programot raknak fel, aminek segítségével a kutatók MIDI fájlokból importálhatnak be zenét a TensorFlowba, hogy az megtanulja a különböző stílusokat és harmóniákat.

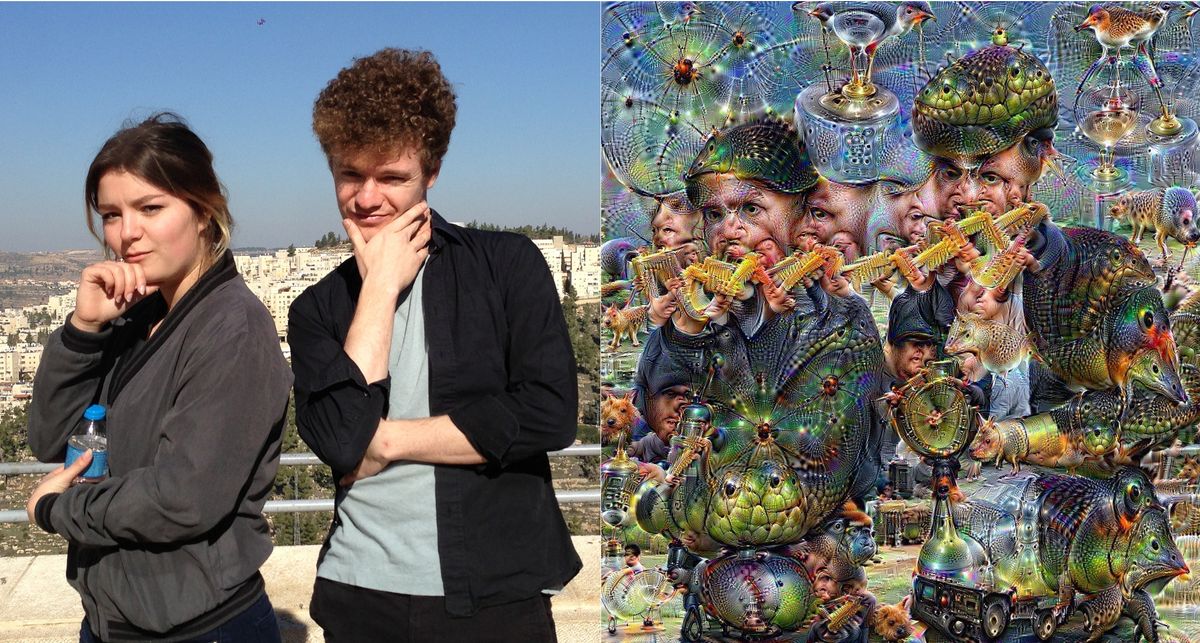

Hogy az AI alkosson, nem újkeletű ötlet: a Google DeepDream szoftvere absztrakt festményeket készít az alapján, hogy milyen formákra asszociál a kép egyes részleteit látva - ugyan önálló alkotásra még nem képes.