Pedofil képekkel tanították be a mesterséges intelligenciákat

Nagy botrányt tört ki a német LAION körül, a vállalat gépi tanulást használó modellek fejlesztői számára biztosít olyan adatkészleteket, amelyekkel azok betaníthatják a mesterséges intelligenciás modelljeiket. A legnépszerűbb adatkészlete az 5 milliárdnál is több képet tartalmazó LAION-5B, többek közt a Stable Diffusion képgenerátor készítői is ezt veszik igénybe.

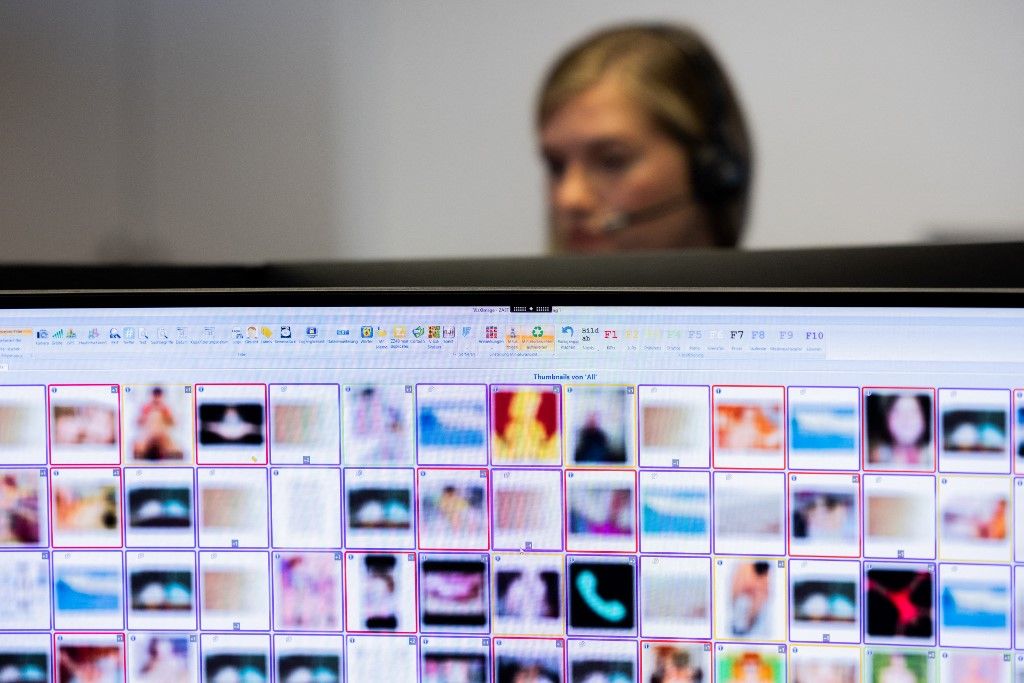

A Stanford Egyetemhez tartozó Internet Observatory labor egyik kutatója a napokban komoly bombát dobott az adatkészlet kapcsán: David Thiel nyomozása szerint az internet legkülönfélébb zugaiból gépileg összegereblyézett LAION-5B képtárba pedofil tartalmak kerültek, rengeteg gyanús fotó mellett ezernél is több bizonyítottan gyermekbántalmazásos képet talált a repertoárjában.

A leleplezésre a LAION elérhetetlenné tette az érintett képtárat, állítása szerint zéró toleranciája van az illegális tartalmakkal szemben, a kitisztítását követően újból kiadja majd a LAION-5B-t.

Mindez viszont nem orvosolja a gondot, hogy a készlettel már betanított MI-k „szennyezettek", hacsak a fejlesztőik a saját szakállukra ki nem gyomlálták az adatkészletből az illegális képeket. Az említett Stable Diffusion fejlesztői például ezt tették, a modelljük 2.0-s verziójától kezdve egyénileg tisztított készletet használnak a rendszerük betanítására.

Ha szeretne még több érdekes techhírt olvasni, akkor kövesse az Origo Techbázis Facebook-oldalát, kattintson ide!