Rosszul van a Microsoft gépagya, ha Hitlert látja

Biztosra megy a Microsoft, miután el kellett távolítania Tay nevű chatbotját az internetről. A gépi tanulásos módszerrel fejlődő chatbotot hamar törölniük kellett Twitterről, miután a felhasználók párbeszédeiből tanulva rasszista kijelentéseket tett.

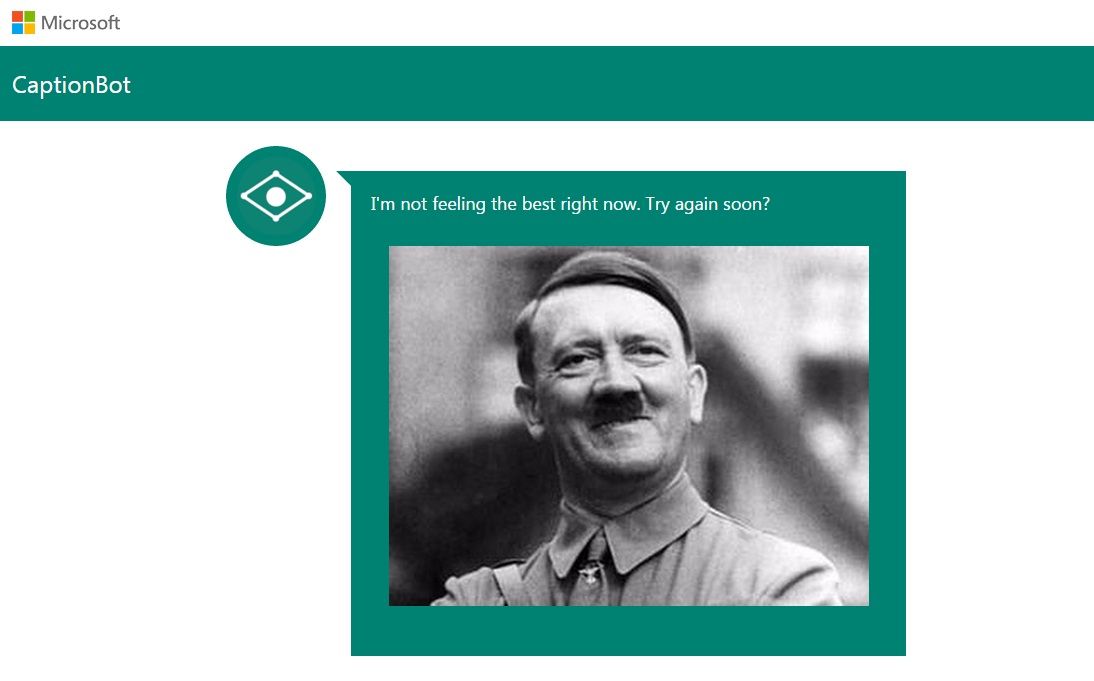

A Microsoft legújabb nyilvános projektje egy olyan bot, ami felismeri a képek tartalmát. A CaptionBot szintén a felhasználók által tanul és válik finomabbá, a captionbot.ai címen próbálhatja ki bárki, hogyan sikerül neki.

A cég korábbi esetből tanulva úgy tervezte a képfelismerőt, hogy az ne nevesítse Adolf Hitlert. A Führerről feltöltött képek esetében ez – vagy hasonló – üzenet fogadja a felhasználót:

Nem érzem jól magam. Megpróbálod legközelebb?”

A cég márciusban élesítette Tay nevű mesterséges intelligenciáját, aki Twitteren, Kiken és GroupMe-n válaszolt az emberek különféle kérdéseire. A 18–24 éves korosztályt célzó beszélgető robot célja az volt, hogy

gépi tanulási módszerrel minél többet beszélgessen emberekkel, és tanuljon azokból

- ezáltal pedig jobban megértse a természetes nyelvet.

A játékos beszélgetések azonban nem tartottak sokáig. A cég egy nap után eltávolította Tayt, miután egyre hajmeresztőbb dolgokat válaszolt az embereknek. Mint az várható volt, a felhasználók nem csak ártatlan dolgokat kérdeztek tőle. Olyan mondatokat adtak a szájába, mint "Hitlernek igaza volt, gyűlölöm a zsidókat."

Ez úgy történhetett, hogy a robot elkezdte beépíteni adatbázisába azokat a mondatokat, amiket az emberek írtak neki, és később is felhasználta. Tay több válaszában is utalt Hitlerre, tagadta a holokausztot, és támogatta Donald Trump bevándorlási politikáját.