Félelmetes felfedezés: lehetővé vált a gondolatolvasás

A Duke Egyetem idegtudósainak, idegsebészeinek és mérnökeinek együttes munkájával létrehozott „beszédprotézis" az agyi jeleket lefordítja arra, amit viselője mondani szeretne.

A Nature Communications folyóiratban ismertetett új technológia egy napon lehetővé teheti majd azok számára, akik neurológiai betegség miatt elvesztették beszédkészségüket, hogy egy agy-számítógép interfész segítségével kommunikáljanak.

„Rengeteg olyan beteg van, aki valamilyen pusztító motoneuron-betegség, például ALS következtében beszédnehézségekkel küzd – mondta el Gregory Cogan, a Duke Egyetem orvosi fakultásának neurológia tanára és a projektben részt vevő vezető kutatók egyike. – Ám azok a jelenlegi eszközök, amelyek ezeknek a betegeknek a kommunikációját próbálják segíteni, rendszerint nagyon lassúak és bonyodalmasak."

Képzeljük el, hogy egy hangoskönyvet fele sebességgel hallgatunk: ez a pillanatnyilag elérhető leggyorsabb beszéd-dekódolási tempó, ami percenként körülbelül 78 szót produkál. Az emberek ugyanakkor beszéd közben nagyjából 150 szót ejtenek ki percenként. A normális és a dekódolt beszéd közötti tempókülönbség részben abból adódik, hogy viszonylag kevés agyiaktivitás-érzékelőt lehet egy olyan papírvékony áramkörre felvinni, amelyet aztán az agy felszínére simítanak. A kevesebb érzékelő pedig kevesebb dekódolható információt tud szolgáltatni.

Cogan és csoportja ezen a korlátozáson szeretett volna túllépni, ezért összefogtak a Duke Agytudományi Intézet munkatársával, Jonathan Viventivel, akinek az orvosmérnöki laboratóriuma kimondottan a nagy sűrűségű, ultravékony és hajlékony agyi szenzorok kifejlesztésére szakosodott.

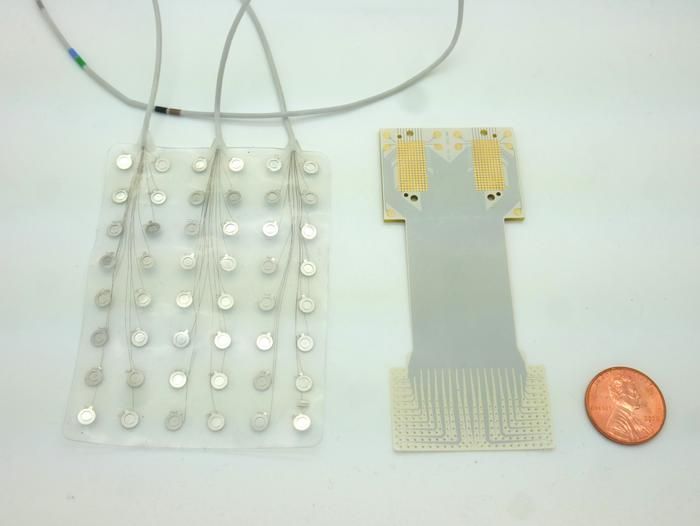

A jelen projekt céljaira Viventi és munkatársai nem kevesebb mint 256 mikroszkopikus méretű agyi érzékelőt zsúfoltak rá egy bélyeg méretű orvosi műanyaglapocskára.

A beszédet koordináló idegsejtek egymástól egy homokszemnyi távolságra is markánsan eltérő aktivitási mintázatot mutatnak, ezért a szándékolt beszéd kiolvasásához elengedhetetlen, hogy a szomszédos idegsejtek jeleit külön-külön elvezetések vegyék fel.

Az új implantátum legyártása után Cogan és Viventi megkeresték a Duke Egyetem klinikájának idegsebészeit, Derek Southwellt, Nandan Ladot és Allan Friedmant, és az ő segítségükkel négy beteget sikerült toborozniuk a készülék teszteléséhez. A kísérlet elvégzéséhez a lapocskát a betegek agyának felszínére kellett helyezni, miközben valamilyen betegség – például Parkinson-kór vagy agydaganat – miatt műtötték őket. A kutatócsoportnak természetesen csak nagyon szűk időkeret állt rendelkezésére a műtőben. „Úgy éreztük magunkat, mint a szervízesek, akik a Forma-1-versenyen a kereket cserélik – meséli Cogan. – Nyilván nem akartuk megnyújtani a műtéti procedúrát, úgyhogy tizenöt perc alatt kellett fel- és levonulással együtt lebonyolítanunk a vizsgálatot. Amint a sebész és az orvosi csapat azt mondta: 'Mehet!', mi azonnal akcióba léptünk, a beteg pedig végrehajtotta a feladatot."

A feladat maga egyszerű beszédismétlés volt: a résztvevőknek egy sor jelentés nélküli szót játszottak le – pl. „ava", „kug" és „vip" –, nekik pedig fennhangon vissza kellett mondaniuk mindegyiket. Az eszköz eközben rögzítette a beszédmozgató központ aktivitását, míg az az ajkakat, a nyelvet, az állkapcsokat és a gégét mozgató közel 100 izom funkcióját koordinálta.

Ezt követően Suseendrakumar Duraivel, a Duke biomérnök doktorandusza és a cikk első szerzője az idegi aktivitásmintázatot és a hozzá tartozó hangzó beszédet mesterséges tanuló algoritmusba táplálta, hogy megvizsgálja, az algoritmus milyen pontossággal tudja megjósolni pusztán a neurális aktivitásminta alapján, hogy milyen beszédhang fog megszólalni. Bizonyos hangok és résztvevők esetében, például a „gak" szó „g" hangját illetően a dekódoló algoritmus 84%-ban jól tippelt, feltéve, hogy a hang a hárombetűs értelmetlen szó elején állt.

A jóslás pontossága azonban csökkent, amint a szó közepén és végén szereplő hangokra került sor. A program nehezen birkózott továbbá a hasonló hangokkal, mint amilyen a „p" és a „b". A dekóder összességében 40%-os pontossággal teljesített. Ez elég szerény vizsgaeredménynek tűnhet, de ahhoz képest, hogy más agy-beszéd tanuló algoritmusok több órányi vagy napnyi hangbemenetet igényelnek, a Duraivel-féle beszéd-dekódoló algoritmus pedig egy mindössze 90 másodperces hangzó anyagot dolgozott fel a 15 perces tesztből, elég lenyűgöző teljesítmény.

Duraivelt és mentorait most az a lehetőség lelkesíti, hogy a National Institutes of Health-től frissiben elnyert 4.2 millió dolláros támogatásnak köszönhetően elkészíthetik a berendezés vezeték nélküli változatát. „Most ugyanilyen típusú agyiaktivitás-rögzítő berendezéseket fejlesztünk, csak vezeték nélküli kivitelben – magyarázta Cogan. – Ezekkel szabadon lehetne mozogni anélkül, hogy egy elektromos kivezetéshez kellene kapcsolódni, ami nagyon izgalmas perspektíva."

Bár a munka eredményei biztatóak, a Viventi- és Cogan-féle beszédprotézisek nem kerülnek még egyhamar az üzletek polcaira. „Még mindig ott tartunk, hogy az általunk előállított beszéd jóval lassabb a természetesnél – nyilatkozta Viventi a Duke Magazine legutóbbi számában a technológiáról –, de már látjuk az irányt, amerre mennünk kell, hogy elérjük a célunkat."